一个易用的 LLMOps 平台python源码社区版,旨在让更多人可以创建可持续运营的原生 AI 应用

一个开源的 LLM 应用开发平台。其直观的界面结合了 AI 工作流、RAG 管道、Agent、模型管理、可观测性功能等,让您可以快速从原型到生产。以下是其核心功能列表:

1. 工作流: 在画布上构建和测试功能强大的 AI 工作流程,利用以下所有功能以及更多功能。

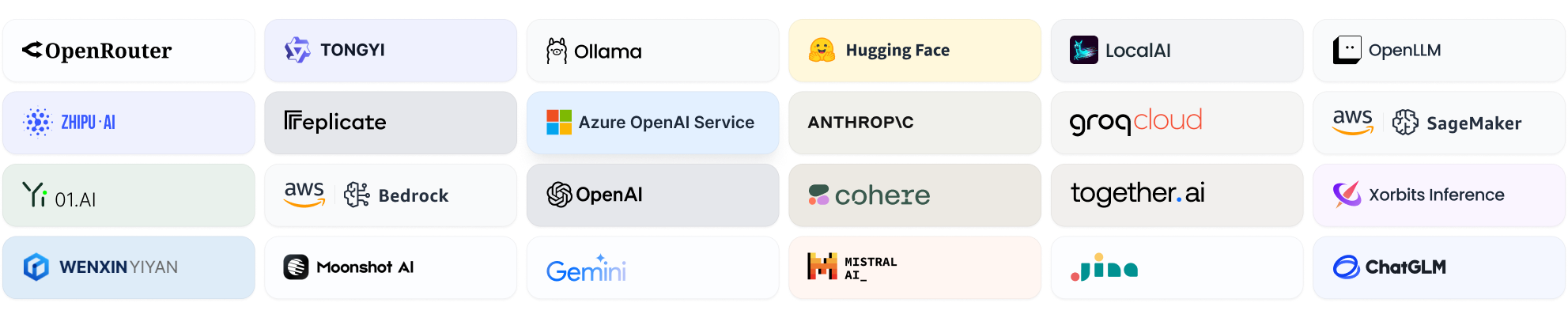

2. 全面的模型支持: 与数百种专有/开源 LLMs 以及数十种推理提供商和自托管解决方案无缝集成,涵盖 GPT、Mistral、Llama3 以及任何与 OpenAI API 兼容的模型。完整的支持模型提供商列表可在此处找到。

一个易用的 LLMOps 平台python源码社区版,旨在让更多人可以创建可持续运营的原生 AI 应用 ...

3. Prompt IDE: 用于制作提示、比较模型性能以及向基于聊天的应用程序添加其他功能(如文本转语音)的直观界面。 4. RAG Pipeline: 广泛的 RAG 功能,涵盖从文档摄入到检索的所有内容,支持从 PDF、PPT 和其他常见文档格式中提取文本的开箱即用的支持。 5. Agent 智能体: 您可以基于 LLM 函数调用或 ReAct 定义 Agent,并为 Agent 添加预构建或自定义工具。Dify 为 AI Agent 提供了 50 多种内置工具,如谷歌搜索、DALL·E、Stable Diffusion 和 WolframAlpha 等。 6. LLMOps: 随时间监视和分析应用程序日志和性能。您可以根据生产数据和标注持续改进提示、数据集和模型。 7. 后端即服务: 所有 Dify 的功能都带有相应的 API,因此您可以轻松地将 Dify 集成到自己的业务逻辑中。 功能比较功能 |

|

| |

| | 编程方法 |

|

| |

| | 支持的 LLMs |

| | |

| | RAG 引擎 |

|

| |

| | Agent |

|

| |

| | 工作流 |

|

| |

| | 可观测性 |

|

| |

| | 企业功能(SSO/访问控制) |

|

| |

| | 本地部署 |

系统要求在安装之前,请确保您的机器满足以下最低系统要求: - CPU >= 2 Core

- RAM >= 4 GiB

快速启动启动服务器的最简单方法是运行我们的 docker-compose.yml 文件。在运行安装命令之前,请确保您的机器上安装了 Docker 和 Docker Compose: - cd docker

- cp .env.example .env

- docker compose up -d

运行后,可以在浏览器上访问 http://localhost/install 进入 Dify 控制台并开始初始化安装操作。 自定义配置如果您需要自定义配置,请参考 .env.example 文件中的注释,并更新 .env 文件中对应的值。此外,您可能需要根据您的具体部署环境和需求对 docker-compose.yaml 文件本身进行调整,例如更改镜像版本、端口映射或卷挂载。完成任何更改后,请重新运行 docker-compose up -d。您可以在此处找到可用环境变量的完整列表。 使用 Helm Chart 部署使用 Helm Chart 版本或者 YAML 文件,可以在 Kubernetes 上部署。 - Helm Chart by @LeoQuote

- Helm Chart by @BorisPolonsky

- YAML 文件 by @Winson-030

使用 Terraform 部署使用 terraform 一键部署到云平台

链接:https://pan.quark.cn/s/373ad627dc07

提取码下载:

|  |免责声明|小黑屋|依星资源网

( 鲁ICP备2021043233号-3 )|网站地图

|免责声明|小黑屋|依星资源网

( 鲁ICP备2021043233号-3 )|网站地图