10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

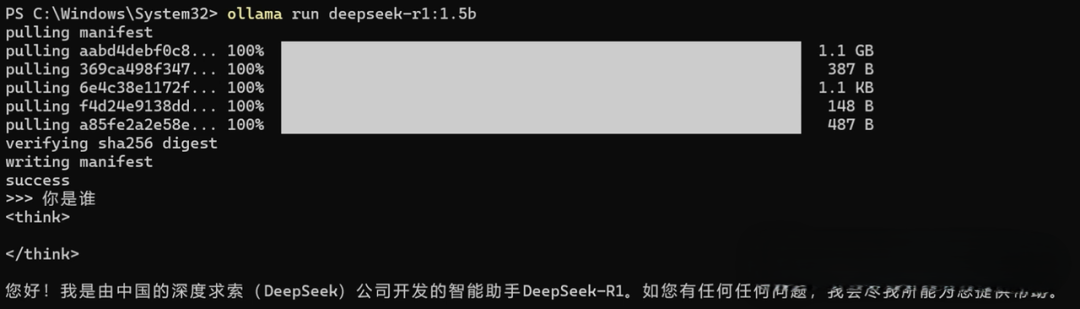

打开浏览器→** Ollama→输入 1 条命令→搞定!这不是魔法,而是本地部署大语言模型的全新方式。Ollama 简化了大型语言模型的运行,让每个人都能在本地轻松体验 AI 的强大。 但是,仅仅运行一个大语言模型还不够。如何让它真正理解你的数据,回答你的问题?这时,AnythingLLM 就派上用场了。 它能将你的文档、笔记、网页等各种数据源连接到本地 Ollama 运行的 DeepSeek 模型,构建一个真正属于你的、个性化的知识库问答系统。告别在海量信息中苦苦搜索,让 AI 成为你高效的知识助手! 关于引入 AnythingLLM 的理由,可以考虑以下几点: 1、数据连接: AnythingLLM 可以连接各种数据源,例如本地文件、网站链接等。 2、多模型选择:AnythingLLM支持各种主流模型的API接入方式,DeepSeek、OpenAI、Gemini等等。 3、易用性: 它通常提供友好的用户界面,方便用户进行配置和管理。 1 Ollama 本地化部署DeepSeek R1 Ollama 是一个用于本地运行大语言模型(LLMs)的开源工具,提供简单的界面和优化的推理引擎,使用户能够在个人设备上高效地加载、管理和运行 AI 模型,而无需依赖云端。 官网下载对应版本,然后根据自己本地配置运行命令。 其中,deepseek-r1:1.5b 换成适配你本地的模型。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

运行命令:ollama run deepseek-r1:1.5b

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

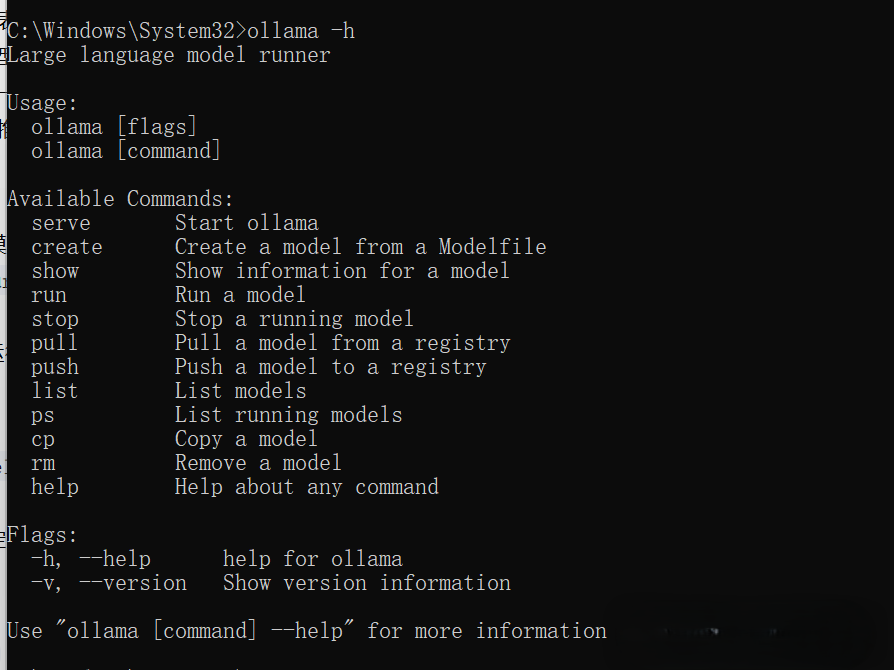

介绍几个Ollama常用的命令: 1、列出本地可用的模型列表:ollama list 2、启动模型:ollama run model_name 3、查看模型信息:ollama show model_name 4、删除指定模型:ollama rm model_name

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

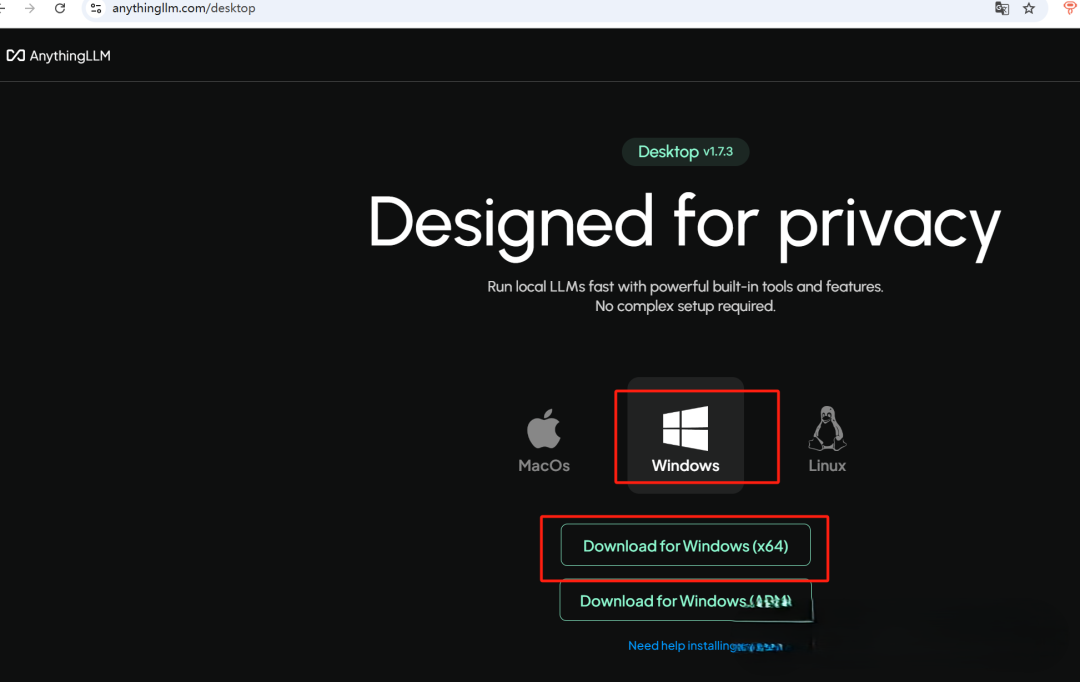

2 部署AnythingLLM 2.1 下载安装 默认路径安装,或者修改默认安装路径都可以。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

安装完成界面:

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

点击完成自动跳转到AnythingLLM界面。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

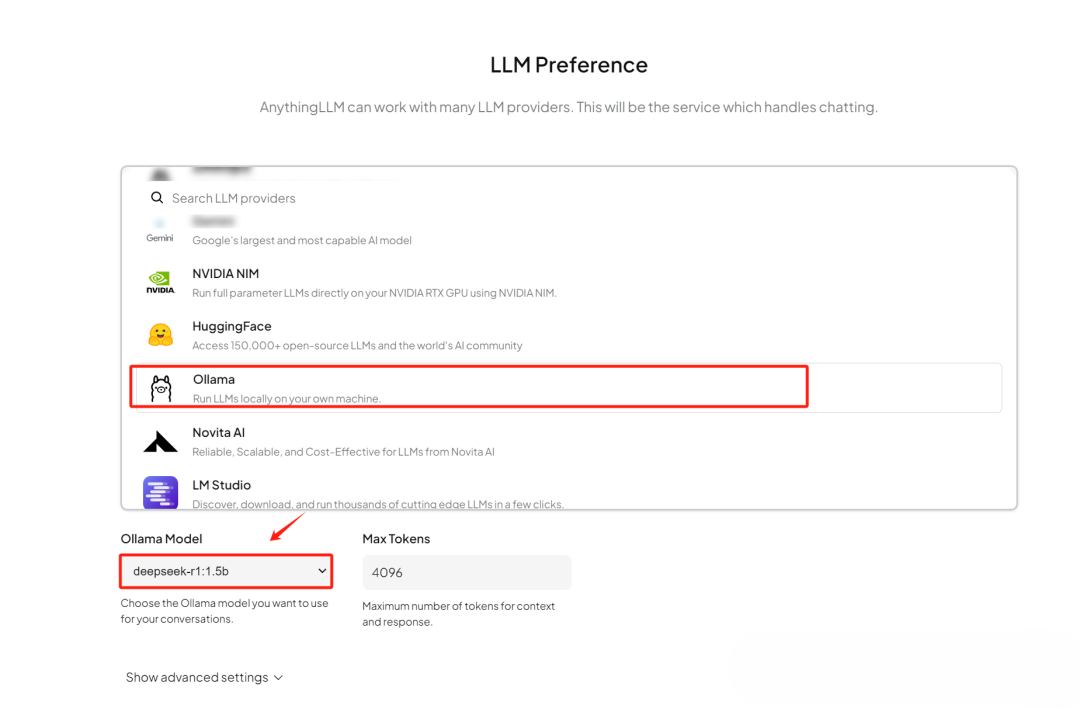

选择Ollama,AnythingLLM会自动检测本地部署的模型,所以前提确保Ollama本地部署的模型正常运行。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

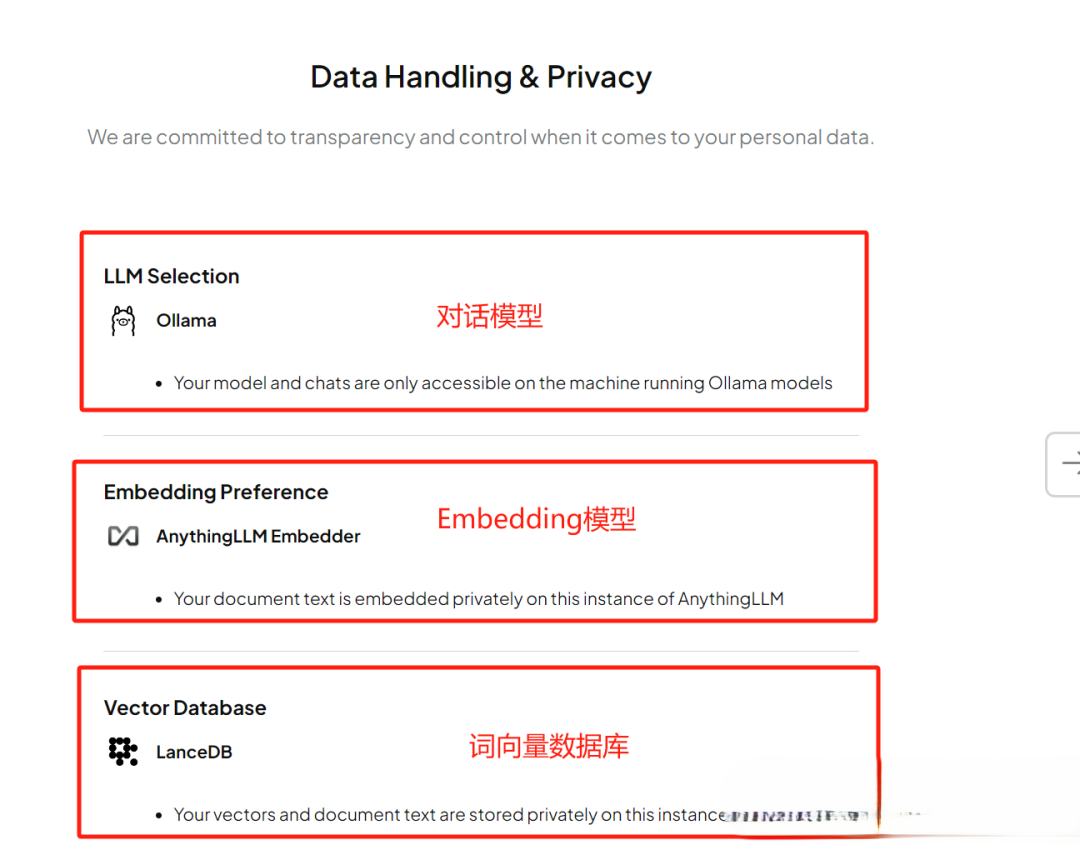

模型配置 1、LLM Selection(大语言模型选择): 这里选择了名为 Ollama 的模型。 说明用户的模型和聊天记录仅在运行 Ollama 模型的机器上可访问,这意味着数据不会在其他地方被存储或访问,从而增强了数据的安全性和隐私性。 2、Embedding Preference(嵌入偏好): 使用了名为 AnythingLLM Embedder 的嵌入工具。 说明用户的文档文本是在 AnythingLLM 的实例上私密嵌入的,这意味着文本数据的处理和转换是在本地进行的,不会泄露给第三方。 3、Vector Database(向量数据库): 使用了 LanceDB 作为向量数据库。 说明用户的向量和文档文本都是存储在这个 AnythingLLM 实例上的,这再次强调了数据的私密性和安全性。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

收集用户对 AnythingLLM 服务的反馈,可选的调查问卷,可直接跳过。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

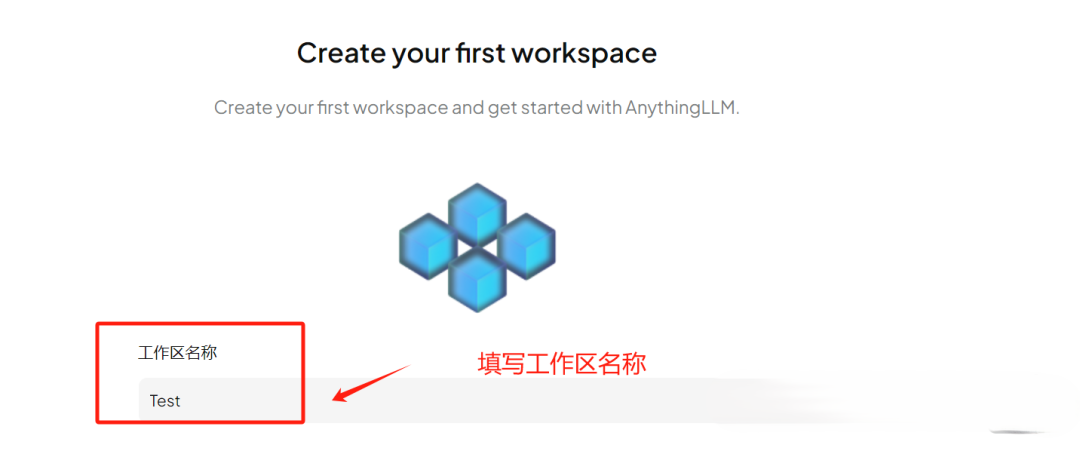

创建工作区,填写工作区名称。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

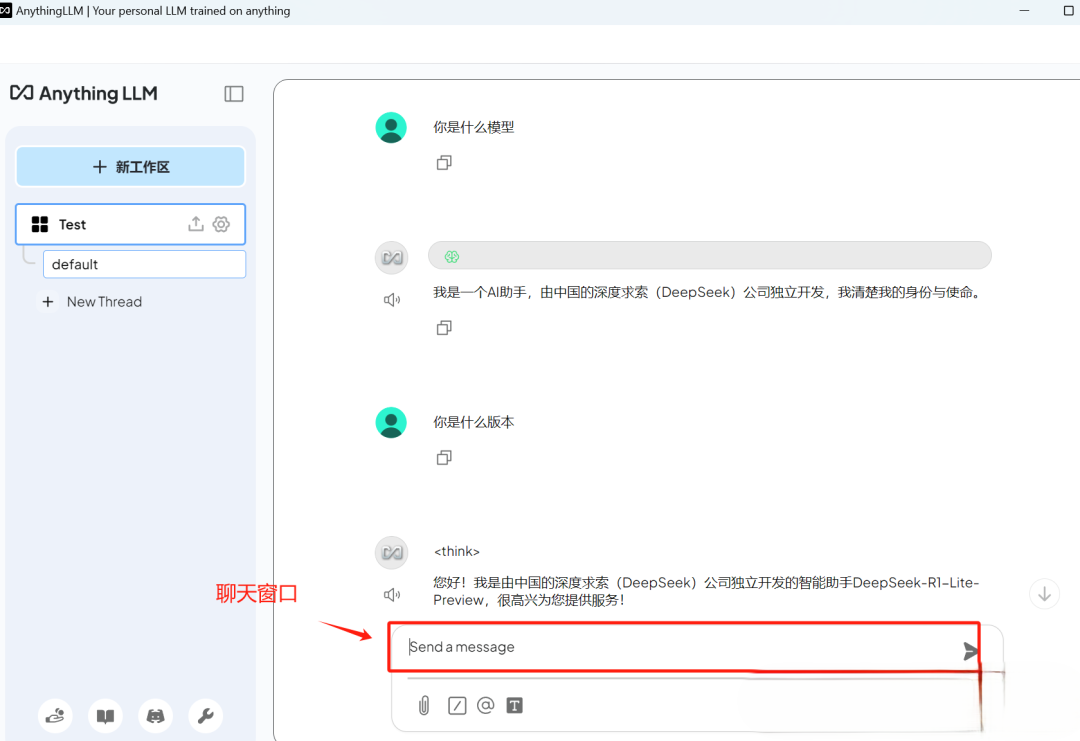

可以在聊天窗口与之对话了。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

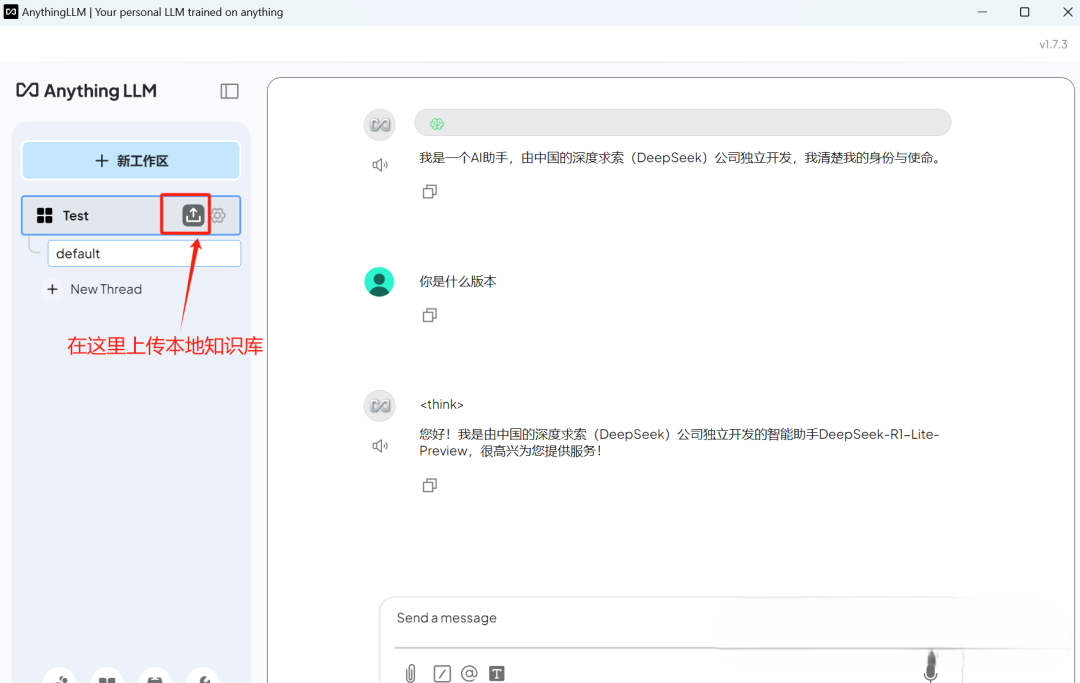

2.2 搭建本地知识库 在左侧工作区找到上传按钮。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

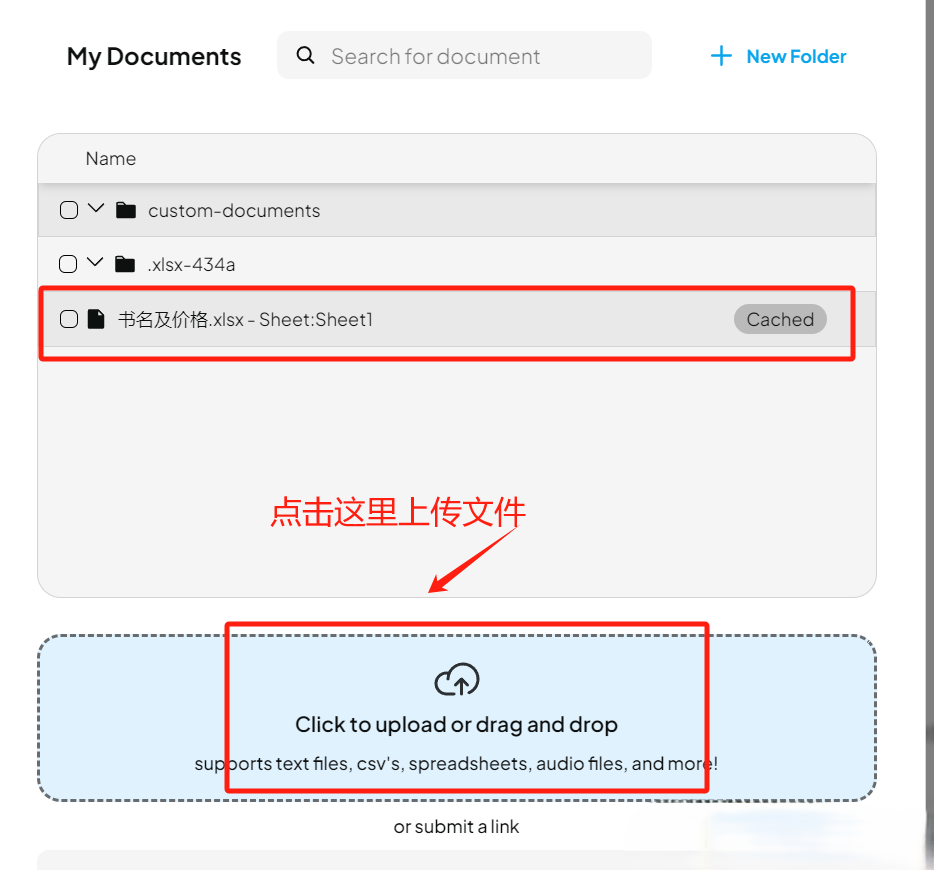

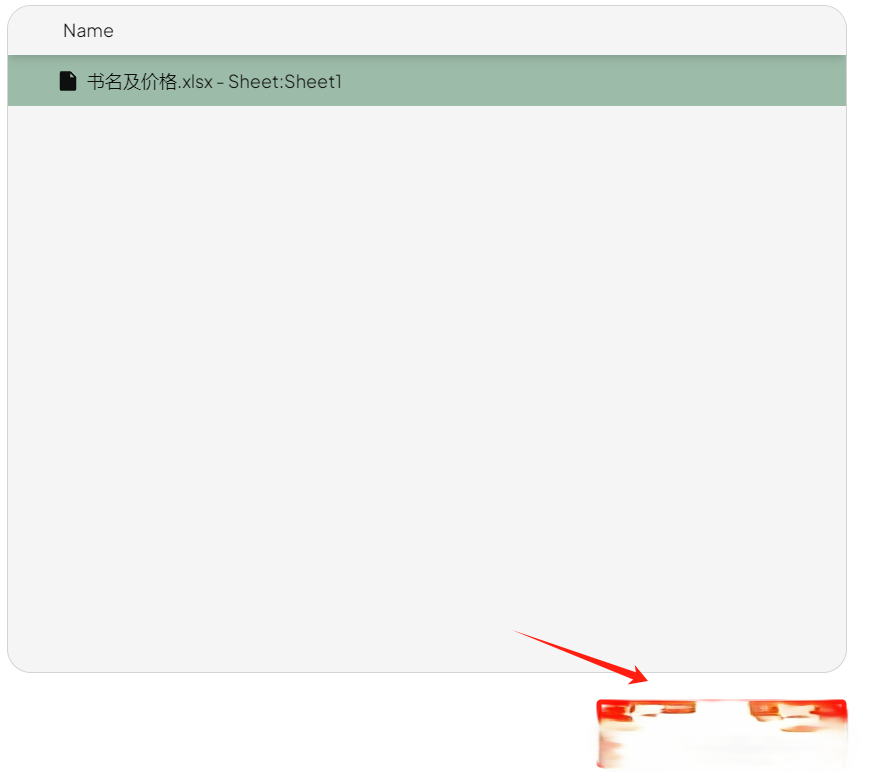

我上传了一个表格文件。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

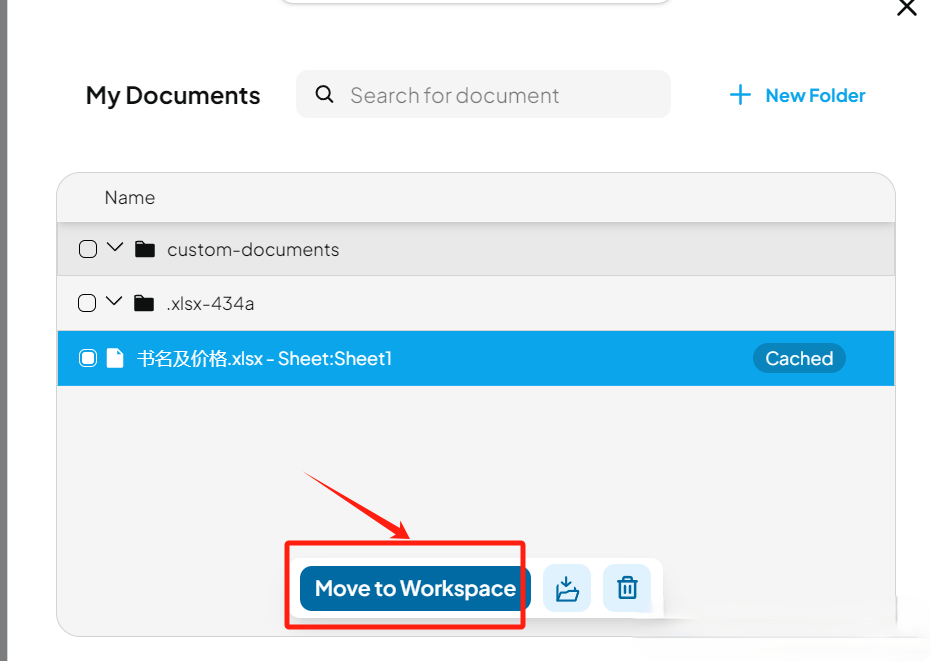

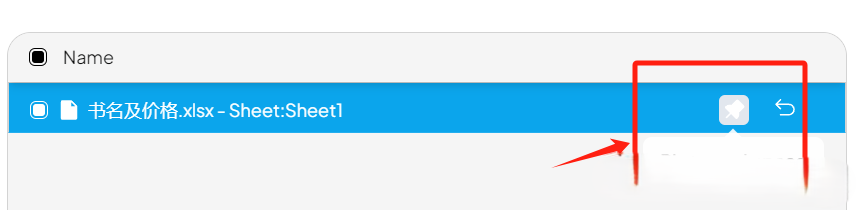

选中上传的文本,点击移动到工作区。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

点击Save and Embed。对文档进行切分和词向量化。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

完成后,点击图钉按钮,将这篇文档设置为当前对话的背景文档。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

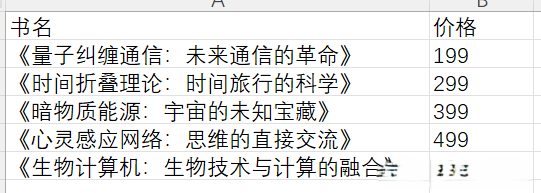

测试效果: 我上传的知识库是虚拟了5本书及价格。随便选中其中一本问下价格。 可以考到模型思考的过程及最终答案,还是非常准确的。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

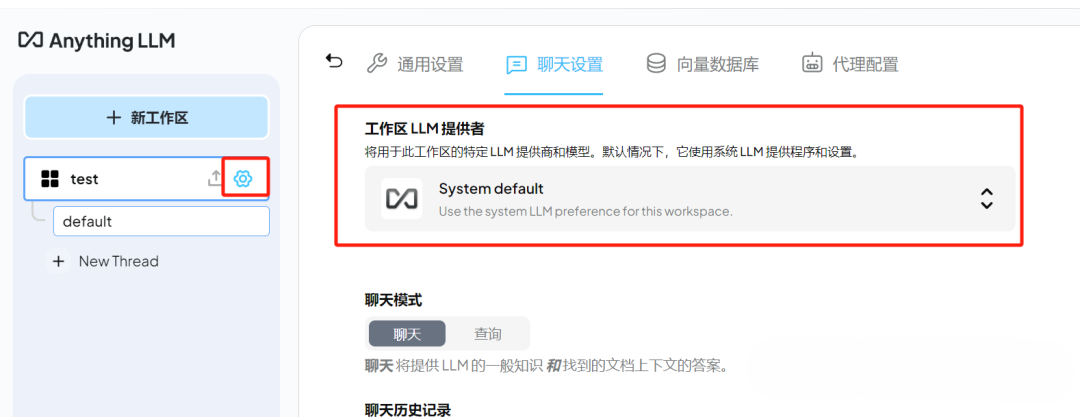

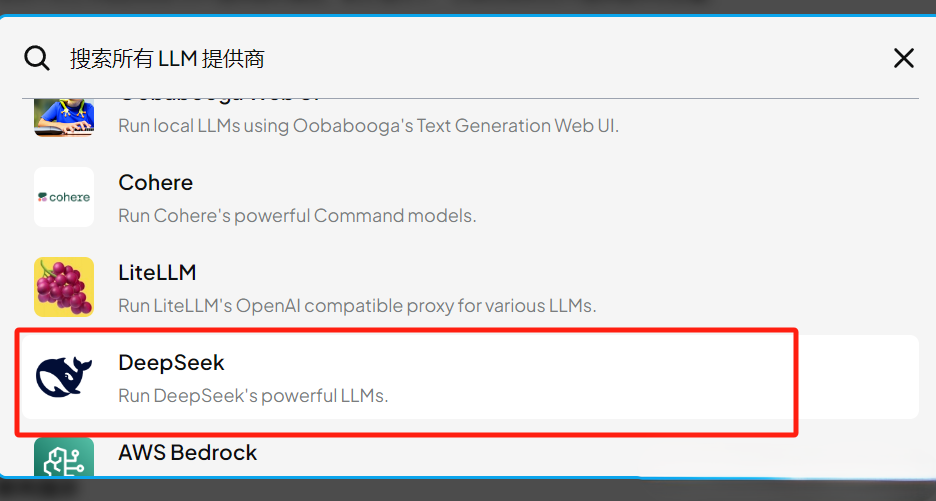

2.3 DeepSeek R1 API 接入LLM 也许有的小伙伴会说,我本地硬件条件有限,就想使用DeepSeek官网服务怎么办? 不要着急,AnythingLLM支持直接调用DeepSeek官方提供的API接口。 在工作区右侧点击设置,选择聊天设置,可以更改LLM模型。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

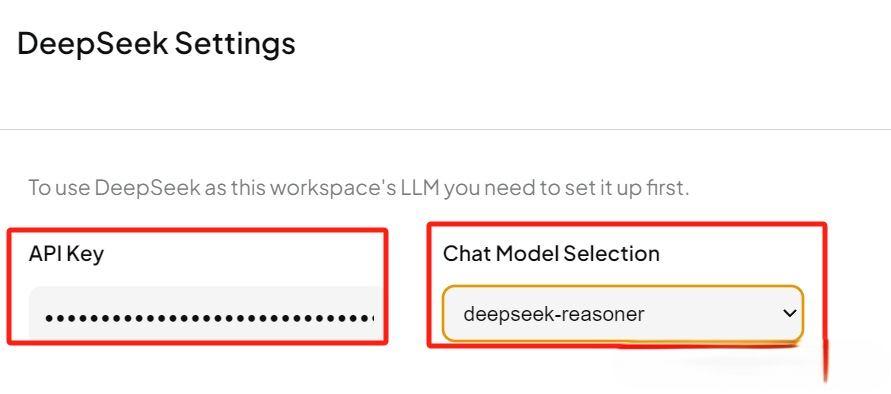

选择DeepSeek,输入API Key,选择DeepSeek R1模型。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

输入DeepSeek API Key,选择DeepSeek R1模型就可以了。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

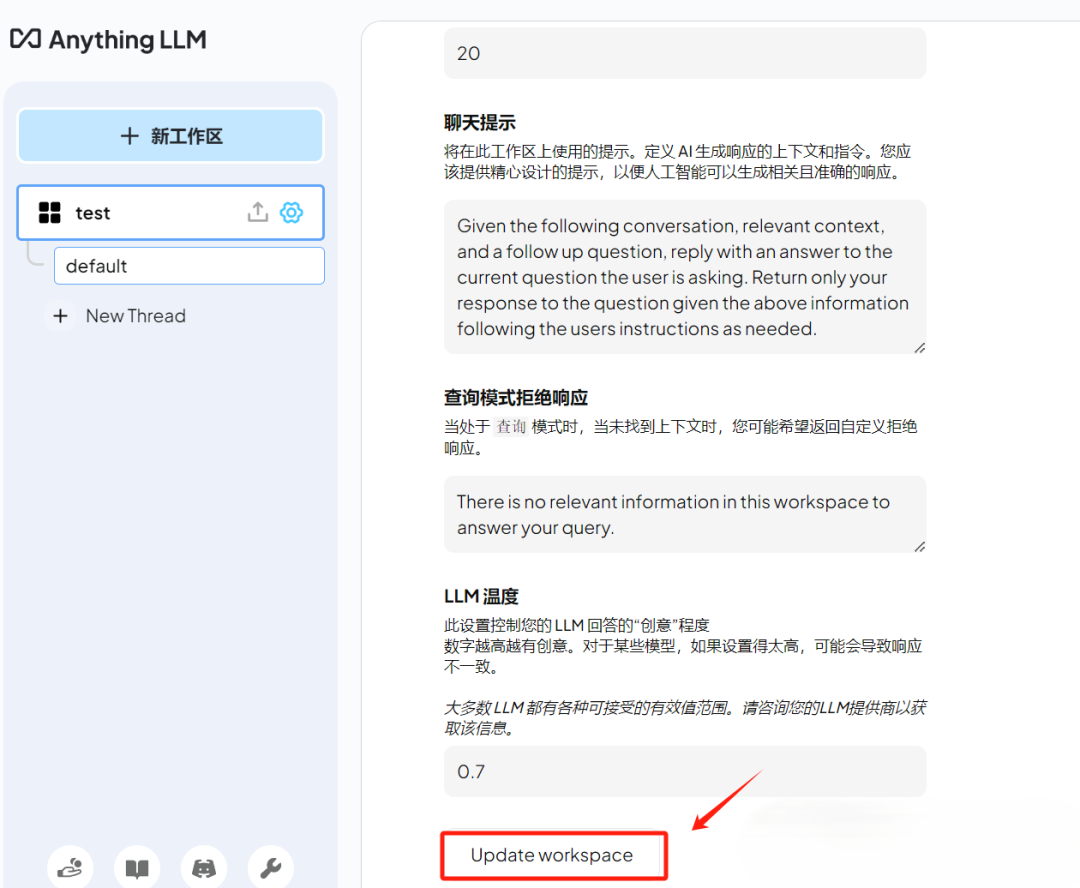

点击最后更新工作区后就可以享受官方提供的大模型服务了。 知识库部署和2.2章节一致,只是调用的模型变为官方API接口。

10分钟搞定,DeepSeek Ollama AnythingLLM 本地部署完全指南,打造专属知识库

看到这里,你是否发现AI私有化部署并没有想象中复杂?其实技术平权化的浪潮早已到来,重要的是勇敢迈出第一步。

AnythingLLMDesktop.exe ,Docker Desktop Installer.exe ,ragflow-main.zip_

Clash.for.Windows-0.20.16-ikuuu可免费使用

|  |免责声明|小黑屋|依星资源网

( 鲁ICP备2021043233号-3 )|网站地图

|免责声明|小黑屋|依星资源网

( 鲁ICP备2021043233号-3 )|网站地图